El nuevo Google Search Console (GSC) es la última versión de este servicio gratuito, antes conocido como Webmaster Tools. Es el resultado de numerosas mejoras y, además, su uso es más sencillo que en las anteriores. Ahora dispone de funcionalidades más desarrolladas y te permite obtener información detallada sobre el desempeño SEO de tu web, posibles fallos y puntos de mejora.

Incluye datos sobre las búsquedas, la procedencia de las mismas, los enlaces de tu página que más aparecen en los buscadores y las palabras clave por las que posicionas, entre otras cosas. Todo orientado para descubrir qué consultas llevan usuarios a tu contenido.

Aunque es fácil de usar, la ayuda de un profesional puede marcar la diferencia en lo que respecta a tu posicionamiento SEO y a tu estrategia de marketing digital. No obstante, en este tutorial vamos a proporcionarte toda la información sobre Search Console que necesitas para tener una visión general de esta herramienta. De esta forma, dispondrás de unos conocimientos básicos para no perderte entre todos los paneles, datos y posibilidades que te ofrece.

Te mostraremos cómo utilizar Google Search Console en su versión más reciente. Así podrás obtener informes, datos sobre tráfico web y echar mano de la ayuda de Google Search Console para solucionar problemas de indexación.

Comenzaremos con una introducción a Google Search Console, en la que te indicaremos, paso por paso, como registrarte y vincular tu web. También sabrás cómo enlazar esta herramienta con Google Analytics para aprovecharla al 100 % y conocerás cuáles son los primeros pasos que debes dar para configurarla, cómo añadir tu sitio web, los tipos de propiedades y las métricas principales.

Gracias a ello, dispondrás de todos los datos necesarios para mejorar tu posicionamiento web. Así crecerá la visibilidad de tu página, y por lo tanto, las posibilidades de llegar a más personas y generar mayores ventas. Un completo y actualizado curso de Google Search Console para llevar tu web al siguiente nivel.

Después de leer la introducción de Search Console y el resto del manual, manejarás unos conceptos generales que te darán una perspectiva muy completa. No obstante, para utilizarlo con soltura, el tiempo que deberás invertir será considerable y requiere de constancia y dedicación. Por eso es recomendable contar con agencia SEO. Así disfrutarás de la máxima productividad y los resultados repercutirán en la buena marcha de tu web y de tu negocio.

En cualqueir caso, ya seas un empresario, un técnico de marketing digital o un desarrollador web, todo este contenido te puede interesar. Encontrarás la respuesta a algunas cuestiones esenciales y ahondamos en funcionalidades de esta herramienta para que sepas sacarle el máximo rendimiento. Si estabas buscando ayuda para manejar Google Search Console, aquí vamos a ofrecerte todo lo que necesitas saber.

Contenido

- ¿Qué es Google Search Console?

- ¿Para qué sirve Google Search Console?

- Primeros pasos con Google Search Console

- ¿Cómo enviar tu sitemap?

- ¿Cómo usar Google Search Console?

- Descripción general (panel de control)

- Inspección de URLs

- Rendimiento

- Índice de Google

- Experiencia del usuario

- Mejoras

- Seguridad y acciones manuales

- Enlaces

- Ajustes

- Herramientas e informes antiguos

- Asociar Google Search Console con Analytics

¿Qué es Google Search Console?

Google Search Console, anteriormente conocido como Google Webmaster Tools o herramientas para webmaster, es una herramienta que te proporciona información de Google sobre tu sitio web y las búsquedas que registra. Además, te indica cómo lo descubren los internautas, cómo lo perciben y cómo se puede mejorar su rapidez y su eficiencia para aparecer en los puestos más altos de los buscadores. Observa el contenido y analiza el tráfico orgánico.

Estos conocimientos que te proporciona este servicio tienen un valor incalculable para una estrategia de SEO eficaz, ya que puedes utilizar las herramientas de optimización y el contenido de ayuda para conseguirlo. Es recomendable que los uses en combinación con los que te proporcionan otras plataformas, como Google Analytics. De esta forma, podrás obtener una clasificación más alta en los resultados de este motor de búsqueda y un tráfico mucho más numeroso en tu sitio web.

Lo mejor de todo es que puedes utilizar Google Search Console gratis. Al igual que otras herramientas que te proporciona esta compañía, como Google Analytics, Google Calendar, Hangouts o Google My Business, este servicio gratuito de Google te ayudará a dar un paso más en el crecimiento de tu negocio en la red.

Como sabes, también hay otras herramientas de Google en las que hay que pagar. Google Ads es una de ellas y te permite publicitar los servicios de tu empresa. Así, solo abonas una cantidad cuando obtienes resultados tangibles, como llamadas telefónicas para solicitar tus servicios o clics para visitar tu sitio web. Sin embargo, este no es el caso de GSC.

Dadas sus similitudes, muchas personas que se dedican a la optimización web y al posicionamiento SEO se preguntan la diferencia entre Google Search Console y Google Analytics. Esto ocurre, sobre todo, cuando no se hace un uso habitual de estos recursos.

El primero de ellos está orientado a las búsquedas. Se centra en los motores y proporciona herramientas y conocimientos que pueden ayudar a los propietarios del sitio a mejorar la visibilidad y la presencia en los SERP o resultados de búsqueda (Search Engine Results Page).

Por otro lado, Google Analytics está orientado al usuario y proporciona datos relacionados con quienes visitan e interactúan con un sitio web.

De esta manera, Google Analytics proporciona información sobre:

- Número de visitantes a su sitio.

- Procedencia de los visitantes.

- Tiempo que pasan los visitantes en su sitio.

- Naturaleza de la visita.

Por su parte, Google Search Console proporciona información como:

- Enlaces a tu sitio.

- Errores técnicos en tu web.

- Consultas de palabras clave.

Ambas funcionan mejor cuando se combinan y se comparten los datos. Por eso, son instrumentos complementarios que deberías enlazar para beneficiarte de todos sus informes, los datos demográficos y métricas de todo tipo.

¿Para qué sirve Google Search Console?

Si te preguntas qué hace Google Search Console para ser una de las herramientas más usadas en tareas de optimización del posicionamiento orgánico, presta atención a la siguiente información.

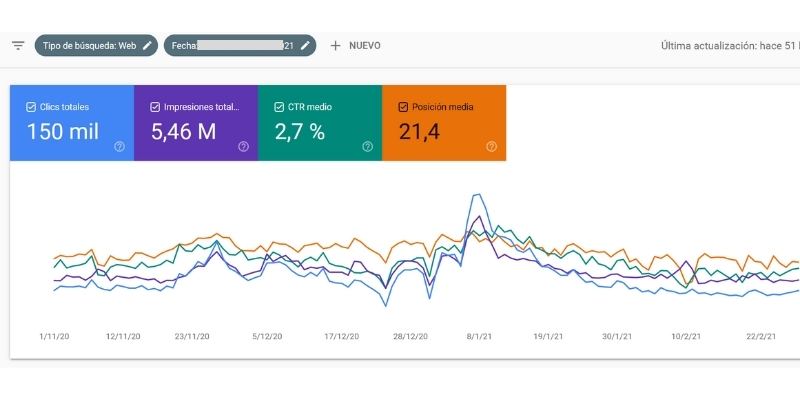

Search Console ofrece completos informes de tus sitios web y las formas de solucionar problemas de indexación. Pero eso son solo algunas ventajas. Google Search Console y SEO son dos conceptos estrechamente unidos. Lo son porque al utilizar herramientas como esta consigues datos clave para mejorar tu posicionamiento. Por ejemplo, sabrás los clics que hacen los usuarios en enlaces, las impresiones, el click through rate (CTR) medio y la posición media de las palabras clave por las que estás posicionando.

También te ayuda a que Google detecte problemas en tu sitio de indexación y a que los corrijas y valides rápidamente para que no se resienta tu posicionamiento orgánico. Sin embargo, existen otros motivos para mostrarte que sitios de tu web deben mejorarse, como veremos más adelante.

Para que Google pueda proporcionarte todos estos beneficios, antes tienes que realizar una serie de acciones de configuración. De esta manera, le proporcionas los datos necesarios a Search Console para entender y analizar toda la información que recibe desde tu sitio.

Como sabes, Google es el buscador más usado del mundo. Por eso, familiarizarte con este recurso de obtención y análisis de datos es decisivo para tu estrategia SEO.

Primeros pasos con Google Search Console

Aprender bien cómo funciona Google Search Console, sobre todo si recurres por primera vez a esta herramienta, requiere familiarizarte con una serie de conceptos y también un poco de práctica. De todas maneras, si necesitas ayuda de search console, la experiencia general de Google y su centro de asistencia es muy positiva. Te resultará muy útil para dar tus primeros pasos.

Como en otros casos de productos de Google, si ya tienes un usuario registrado todo será más rápido. Si no, date de alta con una cuenta de Google o Gmail, acepta las condiciones del servicio y dale a iniciar sesión. Después, teclea en el buscador el nombre de esta herramienta y ya podrás comenzar el proceso. Tendrás la tranquilidad y la garantía de que la gestión de tus datos será totalemente confidencial gracias a Google Search Console y su política de privacidad.

Después de eso, contarás con un email aparejado a esa cuenta y deberás hacer una serie de ajustes de Search Console, de los que vamos a hablar con más detenimiento a continuación.

Accede con una cuenta Google

Como te acabamos de comentar, el primer paso que debes dar es registrarte como usuario de Google. Para acceder a tu cuenta de Google, una vez hayas seguido las instrucciones indicadas, tienes que acceder a la página de inicio de Google. Para ello, una forma de hacerlo es ir a myaccount.google.com. Allí introduce tu nombre de usuario y contraseña de Gmail. Hecho esto, ya estarás dentro de tu perfil de usuario.

Para el Google Search Console loging, lo que tienes que hacer es crear cuenta Google Search Console accediendo el menú principal de la herramienta, como te hemos indicado en el apartado anterior. Allí insertas tu sitio web en el apartado indicado y ya puedes comenzar a usar la herramienta.

Con esto, ya sabrías cómo acceder a Google Search Console.

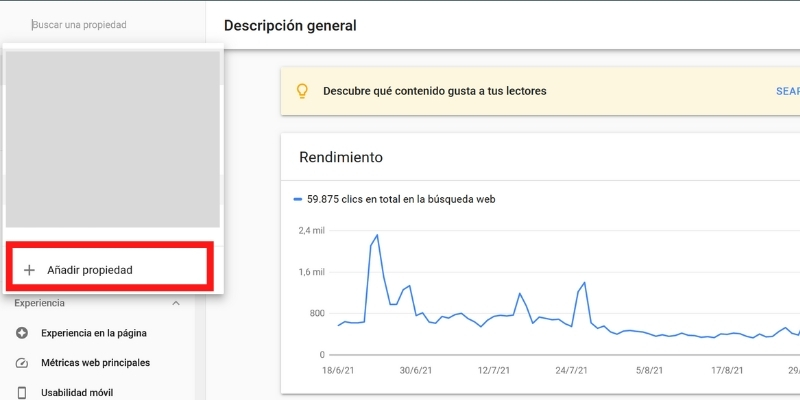

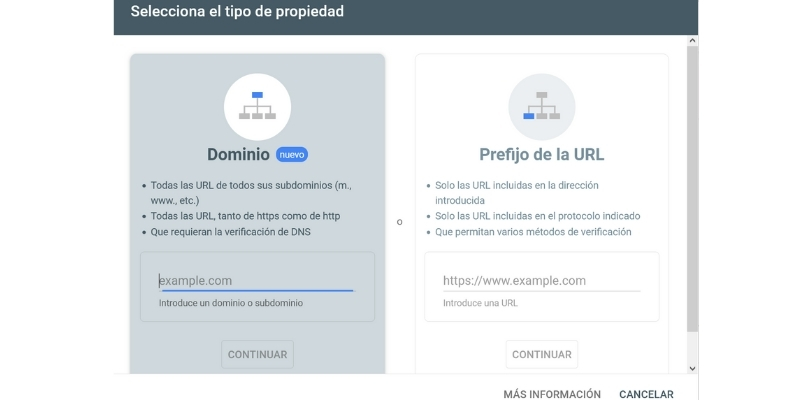

Añadir un sitio web y tipos de propiedades

Como nuevo usuario, deberás agregar y verificar la propiedad del sitio antes de poder acceder a cualquier información de esta aplicación. Esto es un paso clave, ya que Google tiene que asegurarse de que eres el propietario o un usuario autorizado del dominio en cuestión.

Google no puede ni debe entregar la información de cada sitio a cualquier persona que se la solicite. Por eso, antes tienes que pasar por ese pequeño trámite. Hay muchas herramientas que pueden aproximarse a la calidad y al tipo de información ofrecida en Google Search Console, pero esta es la más autorizada, ya que es la fuente real que te informa sobre el comportamiento de tu página en términos de SEO y búsquedas.

SEMRush, por ejemplo, es solo una de las aplicaciones que también pueden proporcionar información adicional para ayudar a complementar tu análisis SEO. Sin embargo, aunque uses esa o cualquier otra, es recomendable que siempre tengas el soporte de la información que te proporciona GSC.

Como te hemos dicho, primero debes iniciar sesión en su cuenta de Search Console mediante una cuenta de Gmail. Si eres dueño de varios sitios web, te sugerimos que mantengas todos tus productos de Google en el mismo correo electrónico. Así podrás cambiar fácilmente entre cuentas.

Luego deberás introducir la URL del sitio web que estás tratando de reclamar y hacer clic en el botón rojo «Agregar una propiedad». La mejor manera de hacer esto para asegurarte de que estás reclamando la versión del sitio es escribir la URL de tu sitio en un navegador, y copiar y pegar esa dirección en GSC. Esto es importante porque hay 4 posibles versiones de un sitio, y si reclamas el incorrecto, no obtendrás la información que necesitas. Sin meternos demasiado en detalles, cada uno cuenta como un sitio y debe reclamarse de forma independiente. Las posibilidades pueden ser las que se muestran en los siguientes ejemplos:

- h t t p s://www.ejemplo.com

- h t t p://www.ejemplo.com

- h t t p s://ejemplo.com

- h t t p://ejemplo.com

La mejor práctica para SEO es asegurarse de que todas estas posibles versiones confluyen en una. Nuestra recomendación es que obtengas un Certificado SSL para estar al día con las últimas novedades de Google y tener una web segura. Con ese certificado tendrás un pequeño archivo de datos que une una clave criptográfica con toda la cantidad de datos de tu web. Cuando instalas ese archivo en tu servidor, se activa el candado de web segura y el protocolo https.

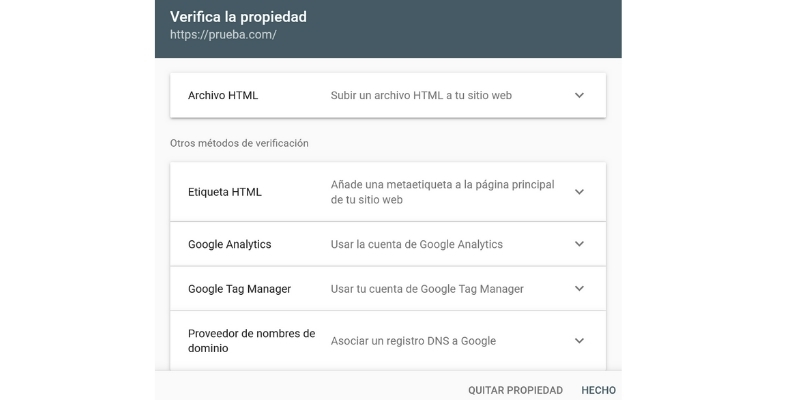

A continuación, te pedirá que verifiques la propiedad del sitio web, lo que se puede hacer de diferentes maneras. Algunas son más fáciles que otras. Todo depende del nivel de experiencia que tengas.

Para verificar tu propiedad, te propondrá un «Método recomendado» que varía de un sitio a otro. También hay otros cuatro métodos alternativos. En realidad, no hay mucha diferencia entre ellos y no importa cuál de los cinco métodos utilices, siempre que lo lleves a cabo correctamente. Estas son las cuatro vías para dar de alta web en Search Console:

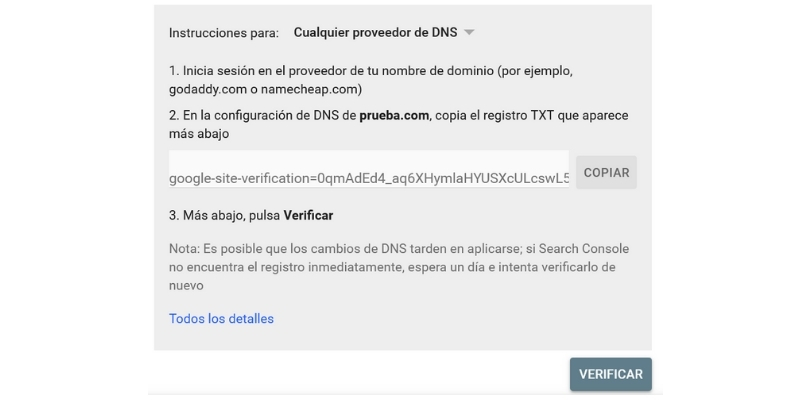

Agregar a través del proveedor de nombres de dominio

El método de usar un proveedor de nombres de dominio es uno de los más difíciles, por lo que normalmente no lo recomendamos. Cada proveedor tiene un método diferente para verificar la propiedad, por lo que deberás seguir los pasos proporcionados por Google realizar esta acción.

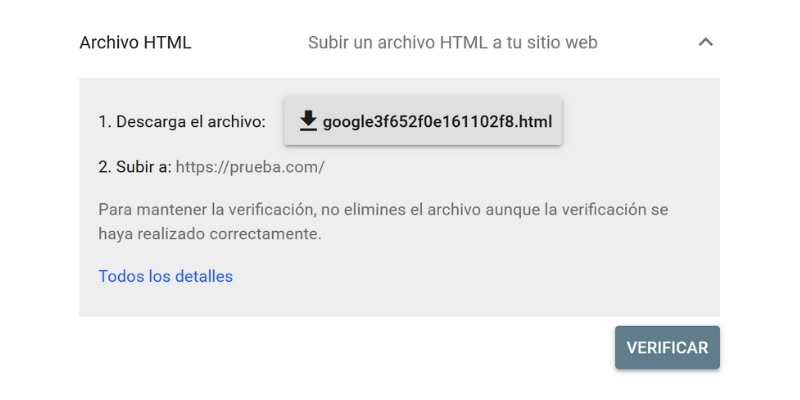

Agregar mediante carga de archivo HTML

Si tienes acceso al directorio raíz del sitio, carga un archivo HTML para demostrar que tienes la propiedad. Deberás seguir las instrucciones, que pueden variar ligeramente de un sitio a otro sitio. Es muy importante que nunca elimines este archivo HTML porque provocarás que tu sitio deje de estar verificado.

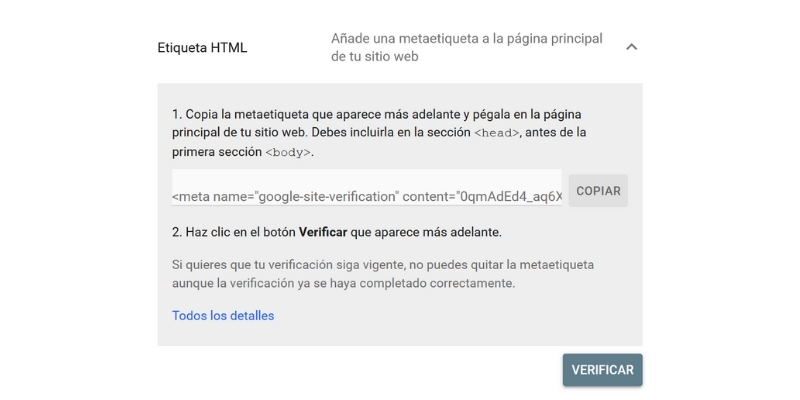

Agregar mediante etiqueta HTML

Si tienes acceso al sitio y estás familiarizado con el código, carga una metaetiqueta HTML a la página de inicio. Para esto necesitarás un plugin denominado Yoast SEO (por poner un ejemplo), que será el encargado de facilitarte el código de autorización de Google Search Console. Cuando lo obtengas, asegúrate de colocarlo dentro de la sección de encabezado de tu web. No importa dónde la coloques, siempre que sea visible dentro de esa sección de la cabecera. En este caso, al igual que en el anterior, nunca elimines este código de tu sitio, ya que se quedará sin verificación.

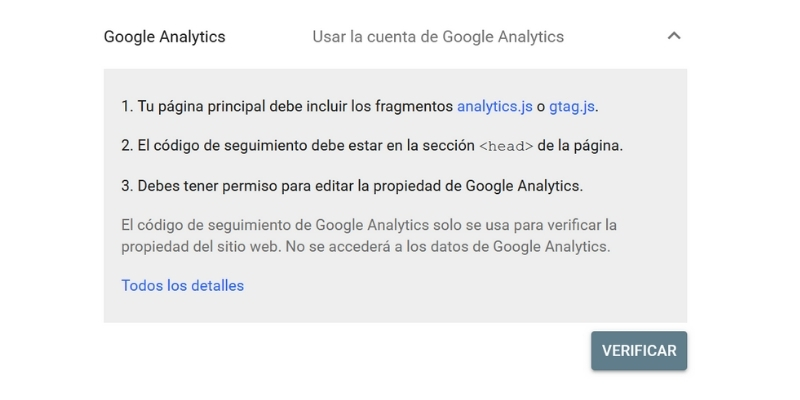

Agregar a través de Google Analytics

Si ya utilizas Google Analytics, esta es la opción más sencilla. Inicia sesión en la misma cuenta de Gmail que has utilizado para configurar GSC y sigue los tres requisitos que se indican a continuación para el Código GA. Luego, solo tienes que hacer clic en verificar y con eso estará todo listo.

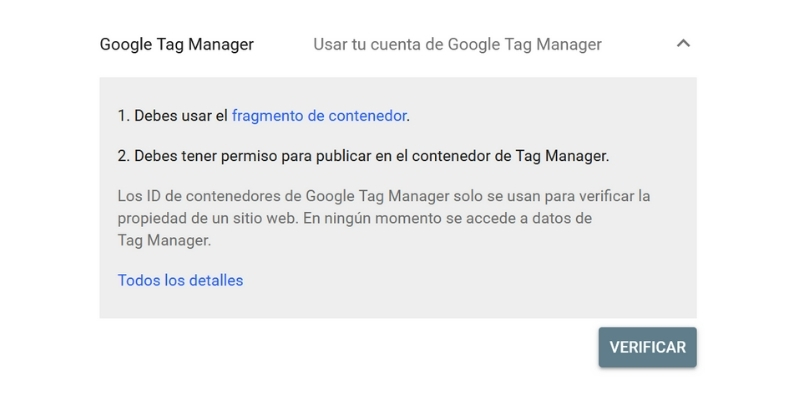

Agregar a través del Administrador de etiquetas de Google tag manager

Si usas Google Tag Manager, esta es la opción más sencilla. Inicia sesión en la misma cuenta de Gmail que vienes usando y sigue los requisitos que te va indicando la plataforma. A continuación, solo tienes que hacer clic en verificar y ya habrás acabado.

Ahora que ya sabes cómo verificar Google Search Console en tu web, comienza a disfrutar de todas las ventajas que te ofrece. Ten en cuenta que si no consigues verificar tu dominio en Google Search Console, no obtendrás los datos correctos de tu propiedad . Por eso es tan importante llevar a cabo esta acción de verificación correctamente en los dominios de tu web.

Instalación y configuración inicial de Google Search Console

Una vez que has introducido y verificado tu web, debes saber cómo configurar Google Search Console. En el icono de ajustes en la esquina superior derecha de la plataforma puedes establecer cómo deseas que se muestre tu sitio cuando alguien lo descubra usando Google.

No importa demasiado qué URL visible utilices, pero, como hemos indicado anteriormente, hay 4 versiones posibles y debes asegurarte de que todas se resuelvan en un formato coherente a través de redireccionamientos 301. Además, esto te evitará problemas de contenido duplicado, pérdida de rango debido a la pérdida de enlaces valiosos, etc.

Google Search Console solo mostrará datos para la sección de análisis de búsqueda según la versión del sitio que se muestre. Si configuras la versión de visualización para que lo haga constantemente como tu versión preferida, será menos probable que divida tus datos entre dos versiones del sitio.

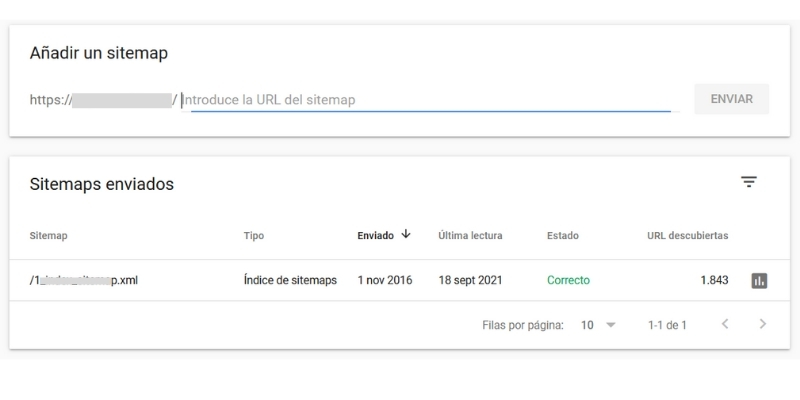

¿Cómo enviar tu sitemap?

Un sitemap o mapa del sitio es un archivo que enumera todas las páginas web de tu sitio para indicar a los motores de búsqueda cómo está organizado el contenido. Si tu sitio está correctamente vinculado, los rastreadores web pueden arreglárselas sin él, pero es mejor que no te arriesgues y envíes este archivo a Google.

Esta acción resulta mucho más sencilla en la nueva versión de GSC. Para que Google indexe correctamente tu sitio web, debes agregar este archivo con el nombre «sitemap.xml». Para mandarlo, simplemente inserta la URL en las áreas indicadas y luego verifica si se ha indexado la cantidad correcta de páginas.

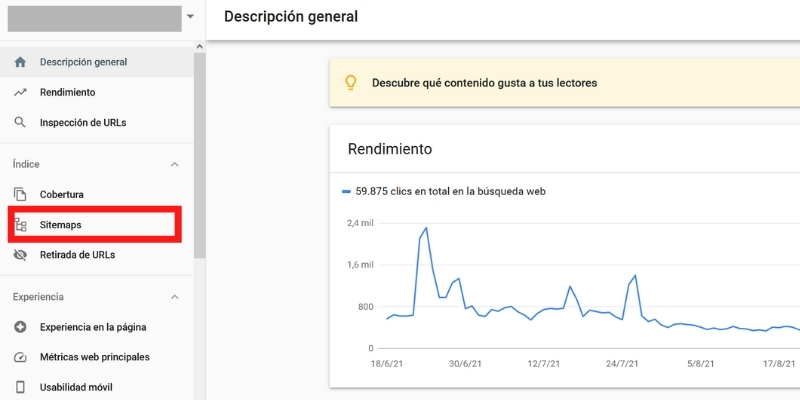

Más concretamente, los pasos que debes dar para enviar tu sitemap son:

- Inicia sesión en GSC.

- Selecciona en sitio web del que deseas enviar el mapa.

- En el menú de la izquierda, selecciona “Sitemaps”.

Introduce lo que se denomina la URL relativa en el espacio indicado para ello y dale a enviar.

¿Cómo usar Google Search Console?

Ahora que ya has agregado tu propiedad insertando la URL de tu sitio web, lo has verificado y has enviado el sitemap, comenzarás a disfrutar de todos los datos que recaba esta herramienta. Pero, antes de nada, asegúrate de que Google puede localizar y realizar la lectura de tus páginas. Para ello, espera unos días hasta que los motores hayan detectado todas las páginas indexables desde que iniciastes este proceso.

Una vez transcurrido ese tiempo, podrás consultar el informe de cobertura de indexación, donde podrás comprobar las páginas indexadas de tu web o las que se han intentado indexar y no lo han conseguido. Así observarás posibles errores y corregirlos.

Otra funcionalidad es la revisión de errores de usabilidad con el dispositivo móvil. Para eso te recomendamos consultar el informe de usabilidad móvil que te proporciona Google, en el que se muestran posibles puntos de mejora. Como sabes, Google tiene muy en cuenta el uso y búsquedas desde el móvil para determinar el posicionamiento. Por eso es tan importante que tu web sea responsive.

Respecto al sitemap, encontrarás un informe al respecto que te proporciona Google para que sepas si está enviado correctamente. Por último, gracias al informe de rendimiento, puedes observar el tráfico de tu web procedente de las búsquedas en este motor. Los datos están agrupados siguiendo criterios como las consultas, las páginas o los países desde donde se realizan esas búsquedas. En cada parte tienes la oportunidad de comprobar las tendencias de muchas métricas, como los clics o las impresiones, por ejemplo.

No obstante, vamos a ir explicándote punto por punto todas las secciones y la información que tienes disponible.

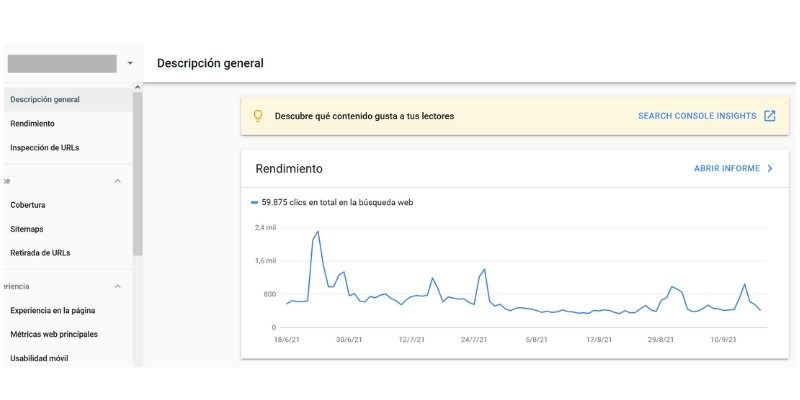

Descripción general (panel de control)

El panel de control de la consola de Google Search Console te ofrece todo tipo de información y encontrarás algunas novedades importantes introducidas en la versión más reciente.

Google te proporciona notificaciones con la información más destacada en relación al desempeño de tu web. Esa misma información te llegará al correo, por lo que podrás estar al tanto de la evolución del sitio y de si, por ejemplo, tiene problemas de cobertura o de usabilidad móvil y diseño responsive.

Así podrás reaccionar y solucionar cualquier incidencia que se presente. Además, si quieres echar un vistazo a todas esas notificaciones, en el panel de control tendrás acceso a un histórico, que se encuentra en la barra lateral de la izquierda.

También hay una parte donde se incluyen datos sobre el estado actual del sitio. En esta área hay una serie de gráficos que resumen los aspectos más importantes. Están agrupados en tres partes, que son los errores de rastreo, analítica de búsqueda y sitemap. Más adelante ahondaremos en ellos.

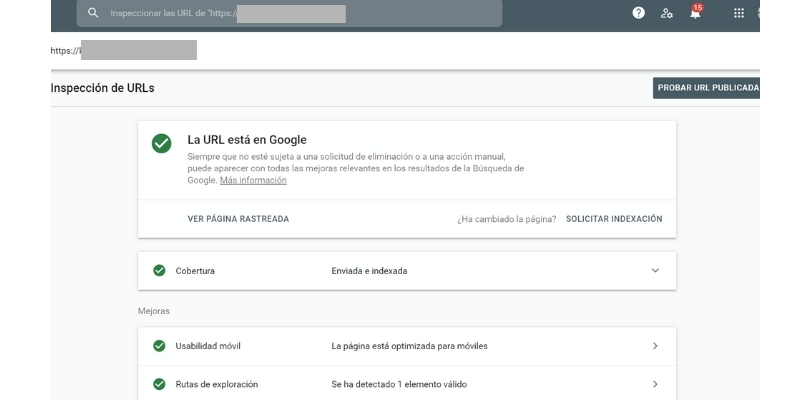

Inspección de URLs

La herramienta de inspección de urls te ayuda a explorar como Google y el nuevo Search Console están obteniendo información de las páginas web de tu sitio. Además, gracias a ella puedes solicitar que se indexe contenido nuevo incluyendo su URL, aunque este proceso no es instantáneo, ya que depende de la frecuencia con la que los robots de Google rastreen tu página (minutos, horas, días…).

Todo esto te permite saber si se producen los citados errores de usabilidad móvil, de datos estructurados o de indexación. Las principales tareas que lleva a cabo esta herramienta son las siguientes:

- Comprobar el estado de indexación de una URL. Además, si no ha sido correctamente indexada, te indica las razones.

- Inspeccionar la URL de una página publicada. De esta forma sabes si puede indexarse correctamente.

- Solicitar la indexación de una URL, para que Google la rastree o, en el caso de que hayas realizado mejoras en ella, para que vuelva a rastrearla.

- Acceder a una versión renderizada de tu página. Así compruebas cómo el robot de Google ve tu página.

- Conocer los recursos que han sido cargados en tu página.

- Solucionar problemas por falta de indexación de una página.

Como ves, hay múltiples acciones que puedes realizar y todas ellas tienen un gran potencial para impulsar tu productividad en términos de SEO.

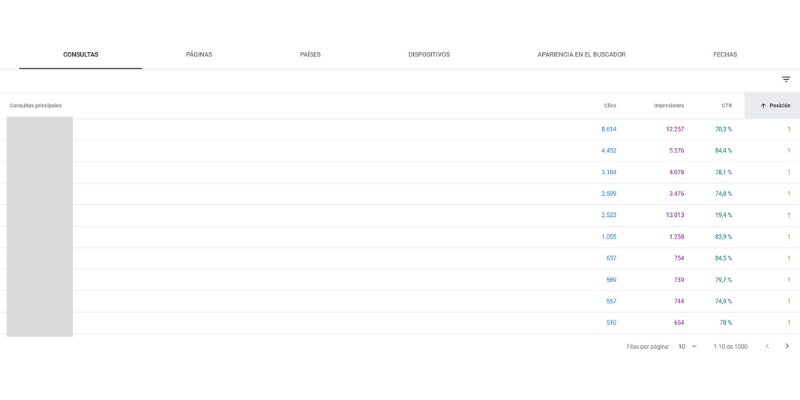

Rendimiento

El informe de rendimiento de Search Console arroja información muy diversa sobre tu dominio. Hay una opción predeterminada que muestra gráficos con los clics y las impresiones que se han registrado en tu página en los tres meses anteriores a la consulta.

No obstante, tú puedes configurar los informes con los datos que desees obtener y elegir las métricas, las dimensiones de los informes y la geolocalización, al tiempo que cotejar y filtrar datos.

Resultados de búsqueda de Google

La sección de los resultados de búsqueda te brinda información sobre algunas cosas que son importantes para tu sitio web en relación con el algoritmo de Google. Estas son:

- Palabras clave.

- CTR medio.

- Backlinks.

- Posición media.

- Enlaces internos.

- Clicks totales.

- Impresiones totales.

- Spam.

- Orientación.

- Compatibilidad con dispositivos móviles.

Si estás familiarizado con el trabajo en el ámbito del SEO, reconocerás que estos son algunos de los pilares más importantes Black Hat SEO. En las anteriores versiones de esta herramienta solo podías ver hasta un máximo de 90 días de datos. Con el lanzamiento de la nueva Search Console, puedes retroceder al menos 16 meses, a veces incluso más, según el sitio. Esto abre la oportunidad de analizar datos año tras año y la capacidad de buscar tendencias a largo plazo.

De esta manera, tendrás una visión muy clara de las consultas que se hacen en los buscadores, las páginas más buscadas y las que menos, los países de procedencia de las búsquedas y los dispositivos desde los que se han hecho.

Puedes averiguar la posición de tu página en cada país y una gran variedad de información interesante. Empieza a utilizar esta herramienta y analiza las impresiones y los clics, descubre qué consultas llevan usuarios a tu contenido, estudia los datos de tráfico de tu web y la procedencia y fecha de cada clic en tu sitio. La recopilación e interpretación de todos estos datos te dará una visión muy completa sobre él.

Además, la sección de aparencia en el buscador se refiere a cómo se muestra el sitio web dentro de la página de resultados de un motor de búsqueda. Si haces clic en la pequeña «i», junto a la apariencia en el buscador, Google te ofrece un desglose con diferentes ejemplos de cómo tu sitio puede aparecer en cualquier página SERP.

Discover

También conocerás el rendimiento de tu página en discover con Google Search Console y accederás a un informe de rendimiento con métricas interesantes. No obstante, solo obtendrás esta información si tu web ha conseguido un número mínimo de impresiones.

Las impresiones totales en este caso se registran cuando un usuario ve una historia, un elemento estándar o uno insertado en un carrusel. Por su parte, también se registran los clics totales en los elementos de Discover y el CTR medio.

Índice de Google

El índice de Search Console es como una biblioteca gigante de información. Si tu sitio está indexado, eso significa que aparece en su base de datos y aparecerá en los resultados de búsqueda. Por eso, la indexación Google Search Console es decisiva para tu posicionamiento orgánico.

Con este informe también puedes detectar problemas de indexación y solicitar la revisión cuando has arreglado las partes de una página que estaban defectuosas.

El estado del index es una sección, ahora desaparecida, que mostraba el número total de páginas indexadas y las páginas que estaban siendo bloqueadas por un archivo robots.txt. Esto ha sido reemplazado por el Informe de Cobertura.

El nuevo informe muestra las páginas exactas que están indexadas y añade las que están excluidas y las que tienen posibles errores o advertencias. Con un solo clic, encontrará las páginas exactas que tienen problemas.

En este sentido, con la acción de explorar como Google sabrás cómo un robot ve tu sitio frente a cómo lo ve un visitante. También te mostrará qué partes de tu página están bloqueadas por un robot de Google. A menudo, si Google procede a bloquear páginas tiene buenas razones para ello. No obstante, esta señal también podría ser un indicador de problemas de calado en tu web.

Es bueno que vayas abordando esos posibles problemas caso por caso para encontrar los fallos y poder solucionarlos. Cuando configures tu sitio por primera vez, deberás solicitar la indexación de Google.

En este proceso de indexación, un robot de Google extraerá la página renderizada y te dará información básica sobre ella. En la parte de estado, podrás recibir mensajes diferentes, ya sea porque tu página está completa, parcialmente completa o está bloqueada.

Si tu página está completa, no necesitas preocuparte por nada. Haz clic en el botón «Solicitar indexación» indicado por la flecha azul y saltará una pantalla emergente. Completa la solicitud y dile a Google que “rastree esta URL y sus enlaces directos”. Esto enviará una solicitud a Google para que, en los próximos días, rastree e indexe todo tu sitio.

Sin embargo, si dice parcial, deberás comprobar si se está bloqueando algún recurso importante. Haz clic en mostrar tus resultados. Desde ahí verás la lista completa de recursos bloqueados, así como la manera en que se ven las páginas tanto desde la perspectiva de un bot como de un visitante. Si hay algo bloqueado que no debería estarlo, tendrás que solucionarlo. También puedes utilizar la recuperación y el renderizado móvil para ayudar con la resolución de problemas.

Como recomendación, tienes la opción de enviar URL a URL para solicitar la indexación de tu nuevo contenido realizando una consulta de búsqueda de Google con la opción «enviar URL». Google intentará rastrear la página de inmediato, aunque eso no significa necesariamente que comenzará a clasificarla al instante. De esta forma, no tendrás que esperar a que Google vuelva a indexar todo tu sitio web para incorporar el nuevo contenido.

Por otro lado, cuando configuras por primer vez Google Search Console, debes incluir un archivo robots.txt. Este indica a un robot web cómo rastrear tu sitio web. En términos generales, un archivo robots.txt bien optimizado debería indicar dónde se encuentra el mapa de tu sitio y las páginas que no deseas que se encuentren.

Este debe estar incluido en el directorio principal o el dominio raíz del sitio o, de lo contrario, los robots asumirán que el sitio no tiene uno y rastrearán todo al completo. Si sospechas que tu sitio o algunas páginas específicas están siendo bloqueadas, verificarlas en la sección inferior insertando la URL específica. Resulta esencial no bloquear las páginas principales de tu sitio o, de lo contrario, nunca aparecerán en los resultados de búsqueda de Google.

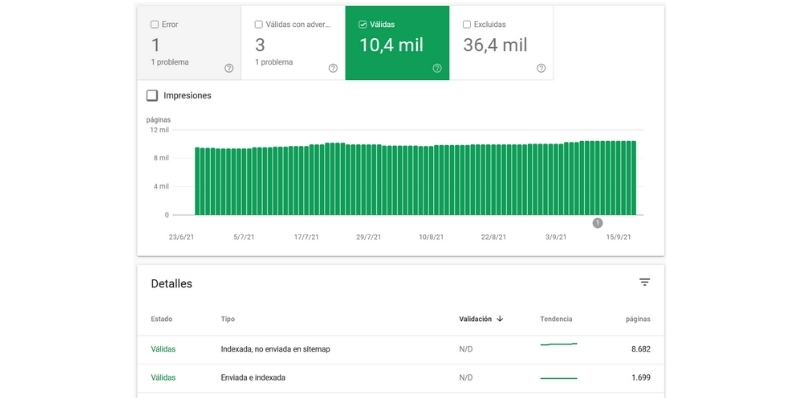

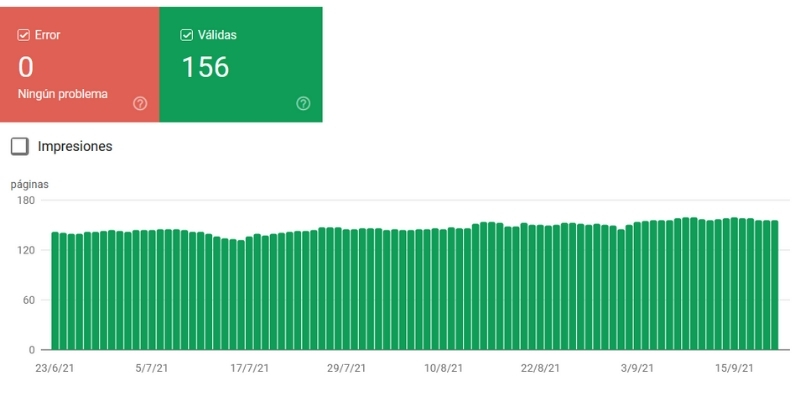

Cobertura

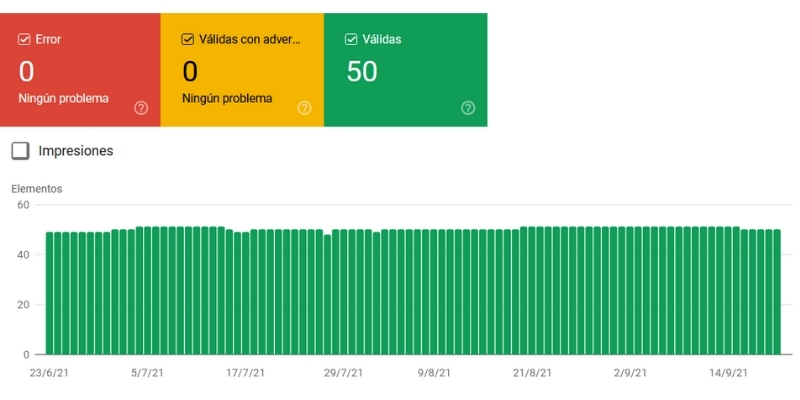

Con el informe de cobertura sabrás si la indexación de las URLs de tu sitio web ha sido correcta. Dicho de otra forma, con esta información conocerás las páginas que han sido indexadas por Google de manera adecuada y las que contienen errores y avisos. Cuando veas que todos los indicadores están en verde, significa que no hay problema, y cuando veas el color rojo, indica que debes revisar el problema y darle solución.

Así sabrás si hay páginas válidas con advertencias, cuáles son válidas y cuáles han sido excluidas de la indexación. Y por si fuera poco, los errores causados por el servidor no serán un secreto para ti, ya que detectarás con Google Search Console errores 404, enlaces rotos o errores 5xx. Podrás detectarlos y atajarlos rápidamente.

El informe de cobertura del índice está ubicado en la sección de índice y contiene toda la información que contemplaba el anterior informe de estado de indexación de la antigua versión. Aquí puedes ver si hay errores de rastreo que impidan a Google detectar tu sitio web. Gracias a ello, podrás recibir alertas cuando google detecte problemas de indexación por spam.

Cuando todos los indicadores están en verde, no hay problema. El color rojo indica que debes revisar el problema y darle solución.

Sitemaps

Ya te hemos hablado de la importancia de añadir un sitemap a Google Search Console. Si has completado esta acción correctamente con el xml del sitemap, en esta parte del panel se te indicará toda la información de las URL que has enviado y las que están indexadas.

No obstante, si acabas de subir el mapa, puede que aún no aparezcan. Dale tiempo a Google y espera unos días para ver los resultados y toda la información completa.

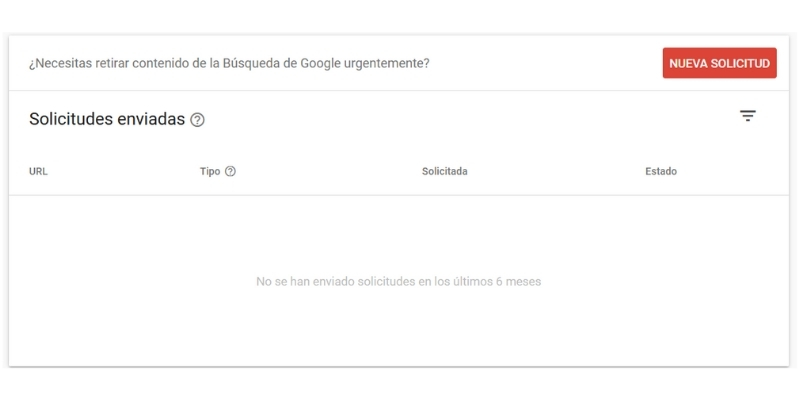

Retirada de URLs

Si alguna vez necesitas llevar a cabo las retiradas temporales de URL de los resultados de búsqueda, usa esta sección. No obstante, no es habitual que necesites utilizar esta parte. Una eliminación solo está activa durante 90 días. Después de eso, Google intentará indexar la página nuevamente. Si necesitas bloquear el rastreo de URL específicas, deberías considerar usar el archivo robots.txt y / o una etiqueta sin índice.

En cualquier caso, para eliminar una url de Google Search Console por contenido obsoleto o por cualquier otra razón, accede a la plataforma, selecciona la página, ve al menú de la izquierda en la parte de Optimización y selecciona «Eliminar URL» en el submenú.

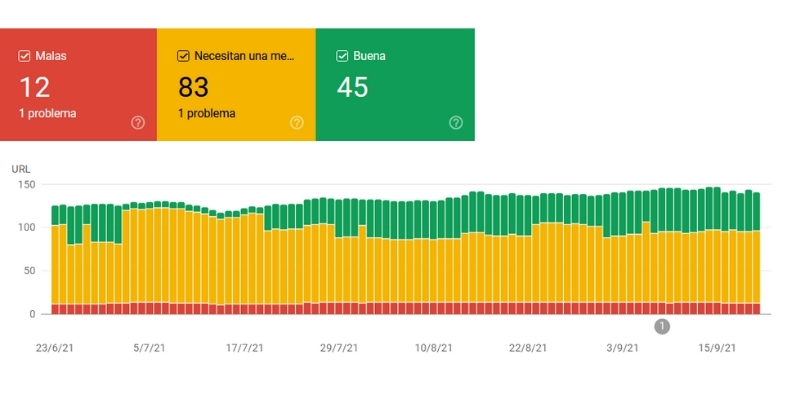

Experiencia del usuario

Esta es una funcionalidad muy reciente y te indica la experiencia de navegación del dominio. Esto incluye nuevos filtros en los informes de rendimiento donde puedes comparar páginas. Hay colores rojo, amarillo y verde que son indicativos de una mala, media y buena navegación.

Aquí se tienen en cuenta consideraciones con una gran importancia para el SEO, la rapidez, la calidad de las URLs, la usabilidad móvil, las rutas de exploración y los enlaces.

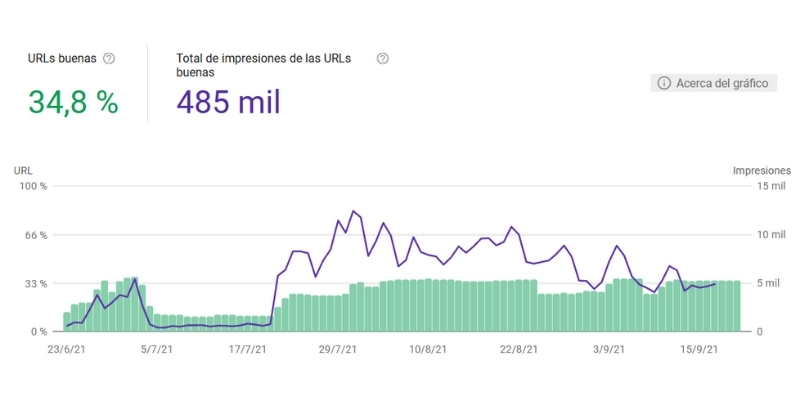

Experiencia en la página

Ahora tienes la posibilidad de saber la calidad de la navegación en tu página y cómo esta influye en la experiencia del usuario. Google te proporciona una gran cantidad de métricas, en las que basa los informes.

Además, incluye un nuevo filtro con el que puedes ver cuál es la página con mejor rendimiento de búsqueda y filtrar páginas con una buena experiencia, lo que te ayuda a realizar un seguimiento y compararlas con otras de tu mismo sitio web.

Métricas web principales

Gracias al informe de «Métricas web principales» observarás la velocidad, la adaptabilidad y la estabilidad en la carga de las páginas. Sabrás si hay urls pobres, urls que necesitan una mejora y cuáles son las urls rápidas.

La clasificación que se hace es de «Buena», «Necesita mejorar» o «Mala». Una buena experiencia significa que todas sus métricas obtienen ese mismo resultado al ser evaluadas. Así mismo, podrás conocer los core web vitals, es decir, las métricas que te hablan de la experiencia de usario.

Usabilidad móvil

El informe de usabilidad móvil y otras funciones que tienen que ver con el diseño responsive dan una idea de cómo Google prima la conexión desde los smartphones. Ya sabes que su política es mobile first. Por lo tanto, el contenido, la navegación y la experiencia del usuario de tu sitio web deben estar optimizados para dispositivos móviles. En esta parte de GSC verás todos los problemas potenciales que Google ha encontrado en tu sitio. Haz clic en cada sección para encontrar un análisis página por página sobre cómo solucionar los problemas.

Es recomendable que trabajes con un desarrollador que comprenda el diseño y el desarrollo de una web responsive para resolver estos problemas.

Mejoras

Esta es un área que te ayuda a impulsar tu SEO y el tráfico de búsqueda, porque te permite saber dónde realizar cambios en las etiquetas de título y las metadescripciones. Deberías tener una etiqueta de título única y una metadescripción en cada página, especialmente en las más importantes, esas que estás tratando de posicionar por palabras clave.

Por eso esta sección puede ponerte sobre la pista para encontrar soluciones fáciles que ayuden a tu sitio a ganar tracción en las clasificaciones. Si haces clic en cualquier elemento resaltado en azul, obtendrás una lista de todas las páginas que tienen problemas de este tipo.

Rutas de exploración

La nueva versión de GSC te ofrece informes de rutas de exploración. Como quizá sepas, las rutas de exploración son las formas en las que llegas a una página web de un determinado sitio y tienen que ver con las jerarquías o niveles de la estructura.

Puede haber varias formas de llegar a un mismo sitio y tú puedes proporcionar a Google Search Console las rutas que desees analizar, para saber cuáles obtienen mejores resultados. Además, el informe te indica si hay problemas con tu esquema de ruta de navegación para que puedas determinar dónde se encuentran y resolverlos.

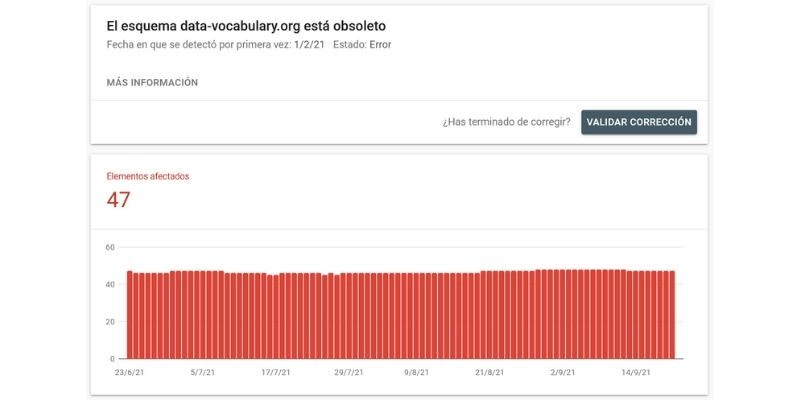

Resultados enriquecidos

Los resultados enriquecidos se usan casi exclusivamente para recetas y otros resultados de búsqueda parecidos, eventos o determinados productos de tu sitio web. En Google Search Console, tienes la posibilidad de utilizar esta sección de la misma forma que la de datos estructurados, ya que son formas de destacar la información para hacerla más atractiva a los usuarios.

Los datos estructurados de Google Search Console se refieren al marcado de esquema que se encuentra en tu sitio. El marcado de esquema, en esencia, es una colección de etiquetas HTML o JavaScript que los motores de búsqueda pueden usar para resaltar las partes más importantes del sitio web, como el nombre, la dirección y el número de teléfono de tu empresa.

De esta forma, con GSC podrás ver qué páginas tienen marcado de esquema y si hay algún error en esas páginas. También puedes ir a la «Herramienta de prueba de datos estructurados de Google» para encontrar estos errores página por página, lo que te mostrará directamente en el código dónde tienes problemas. En esta línea, tienes la posibilidad usar la herramienta de prueba de resultados enriquecidos, para verificar la sintaxis de los datos y, a veces, obtener ejemplos de cómo quedarán las optimizaciones cuando se vean plasmadas en los buscadores.

En definitiva, emplea esta herramienta para saber qué tipo de mejoras necesitan los resultados enriquecidos y los datos estructurados, de manera que se posicionen mejor en las búsquedas.

AMP

El Accelerated Mobile Pages (AMP) realiza un seguimiento de todas las páginas que se han modificado y te informa de cualquier problema conocido. El objetivo es que así puedas solucionar problemas relacionados con AMP y la usabilidad móvil.

Las accelerated mobile pages son extremadamente mínimas y ultrarrápidas. Es un lenguaje de código abierto que ha ganado popularidad en muchos entornos y está indicado por el icono de un rayo en la búsqueda de Google.

Si publicas blogs de forma regular, puede ser una buena idea invertir en tus páginas amp y después rastrear su desempeño con Google Search Console.

Seguridad y acciones manuales

Dentro del completo catálogo de funcionalidades que te ofrece esta herramienta, también dispones de un informe de problemas de seguridad de tu sitio y de acciones manuales. Así detectarás posibles fallos y obtendrás, por ejemplo, un histórico de los cambios manuales realizados en tu sitio web.

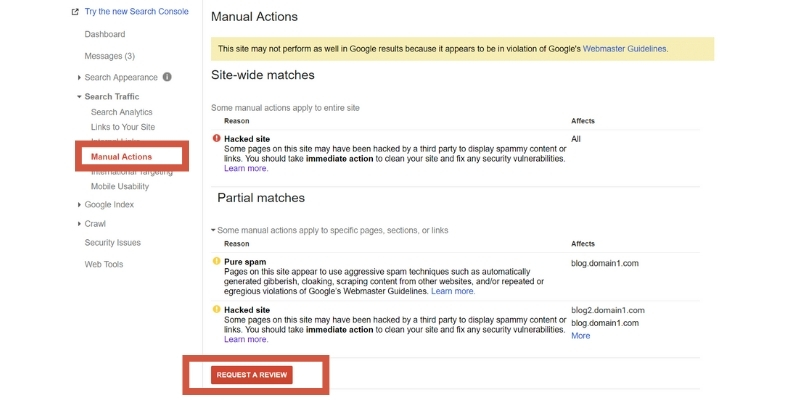

Acciones manuales

Esta es una página increíblemente importante que debes consultar de forma habitual. Aquí, Google te dirá si su sitio ha sido revisado manualmente y se ha determinado que infringe sus políticas.

Si encuentras algo que no sea «No se encontraron acciones manuales de spam web», empieza inmediatamente a tomar medidas para recuperarte. De lo contrario, parte o la totalidad de tu sitio ya no aparecerá en las búsquedas de Google. De ahí la importancia del informe de acciones manuales.

Problemas de seguridad

Respecto a los problemas en tu web relacionados con la seguridad, por lo general, Google detectará y alertará sobre cualquier problema de seguridad que encuentre. Si localiza uno, sigue sus instrucciones para evitar una penalización de acción manual. En estos casos, se puede entender que tu sitio ha sido pirateado o que su contenido podría ser dañino para los internautas. Es entonces cuando saltan las alarmas en los informes de seguridad.

De la misma forma, se detectan riesgos como la suplantación de identidad, conocida también como phising, o la existencia de malware que pueda afectar al sitio o los usuarios.

Enlaces

Gracias a la sección Google Search Console links, obtendrás una gran cantidad de información sobre los enlaces internos y externos de tu sitio web. También puedes obtener otros datos, como los anchor texts más comunes, las páginas más enlazadas o los sitios con más enlaces. Así podrás mejorar mucho el rendimiento de posibles campañas que lleves a cabo para captar links.

Enlaces externos

Los backlinks externos siguen siendo uno de los factores de clasificación más fuertes que puede encontrar un especialista en SEO. El informe de backlinks Google Search Console te mostrará quién tiene más enlaces con tu sitio, qué páginas reciben más vínculos y qué tipo de palabras utilizan otros sitios para vincularse con tu web. Sin embargo, solo se te proporcionará una muestra de los enlaces que recibe tu sitio.

La página inicial a la que accedes para esta página no te ofrece realmente una buena descripción general. Deberás hacer clic en las secciones «Más» para encontrar información útil.

Aquí tendrás una muestra de los enlaces externos que estás recibiendo, pero si haces clic en enlaces individuales, Google mostrará exactamente dónde se pueden encontrar.

No obstante, como estos son solo ejemplos y a veces es bueno hacer una auditoría de backlinks completa, necesitarás usar una herramienta diferente que te lo permita. Es recomendable una auditoría de backlinks si su sitio está bajo algún tipo de penalización de acción algorítmica o manual por tener demasiados enlaces spam que apuntan hacia él.

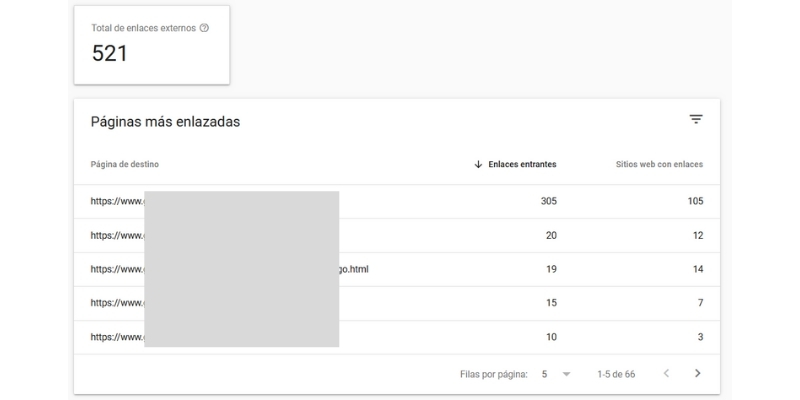

- Páginas más enlazadas

Esta herramienta te indicará cuáles son las páginas más enlazadas. Google nunca te dará la lista completa, ya que alguien podría obtener información sobre su algoritmo y aprovecharse de ello. Además, si se te proporcionan todos los enlaces, el proceso se hace mucho más lento.

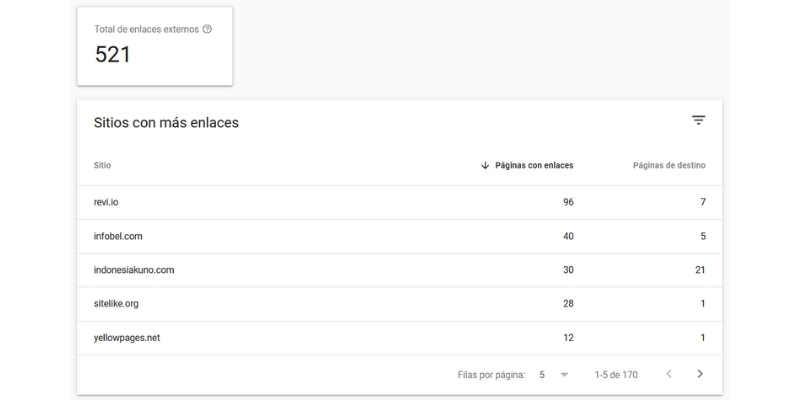

- Sitios con más enlaces

En la sección de dominios de enlace podrás descargar una lista de todos los dominios que enlazan a tu sitio en formato .csv u hojas de Google. Si buscas los datos más completos, descarga la sección de enlaces más reciente. La tabla muestra todos los dominios que enlazan, más los enlaces individuales independientemente del dominio y los más recientes te mostrarán los mismos enlaces individuales pero ordenados por la fecha en que fueron categorizados por Google.

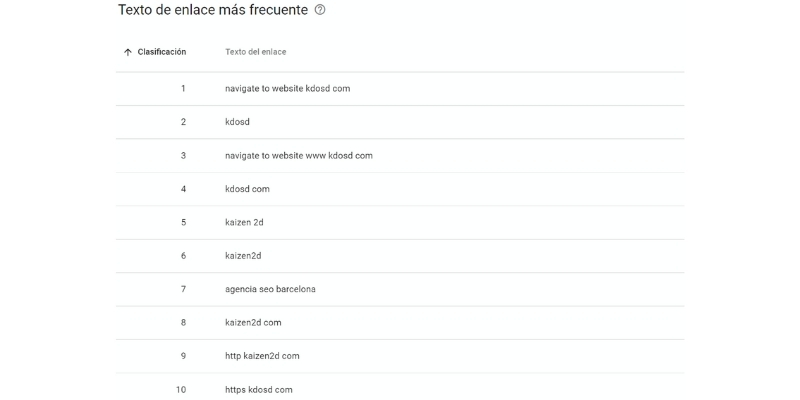

- Texto de enlace más frecuente

Dispondrás de una lista de los principales enlaces y anchor texts utilizados en los vínculos hacia tu sitio. Esta información es útil, aunque si no conoces el contexto donde se utilizan esos textos de anclaje, su valor es muy relativo.

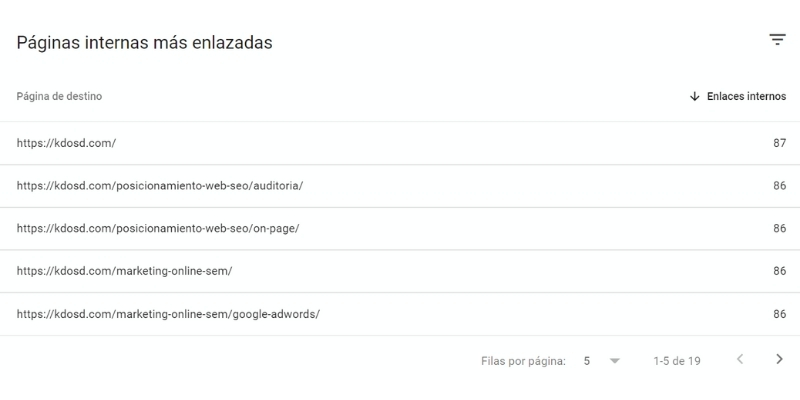

Enlaces internos

La sección de contenido más vinculado te dará, igualmente, una idea de qué páginas de tu sitio tienen una mayor cantidad de vínculos internos y realizar un seguimiento para saber si los resultados son buenos. También te harás una idea de por qué ciertas páginas tienen un mejor rendimiento que otras.

Si deseas medir el éxito de las campañas completas, generalmente es más beneficioso realizar un seguimiento del impacto en las redes sociales y las menciones no vinculadas, ya que estas métricas están ganando más peso en la búsqueda de Google para responder las consultas de los buscadores con las opciones de páginas más adecuadas. En este sentido, puedes usar Google Alerts para rastrear tus campañas.

Ajustes

Además de todas las partes mencionadas anteriormente, hay una serie de ajustes que deberías hacer en este apartado. Te contamos cuáles son.

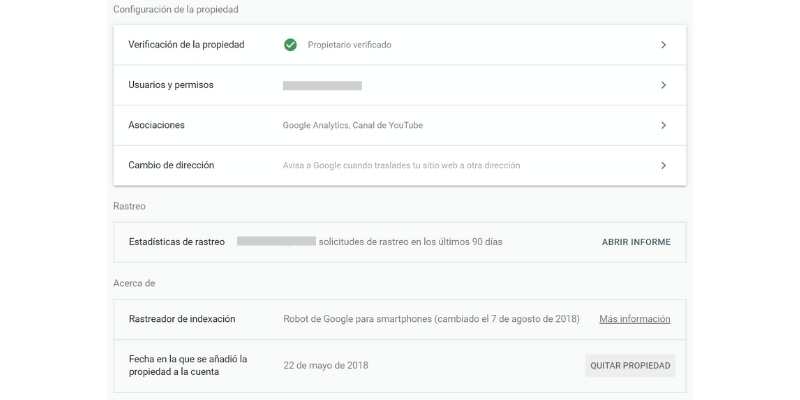

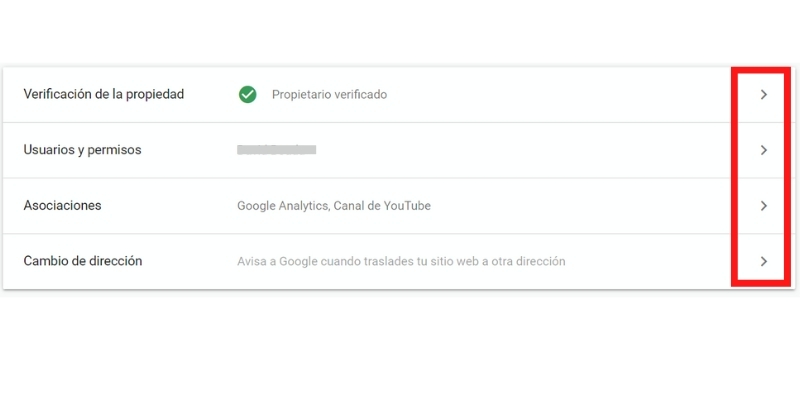

Configuración de la propiedad

Hay tres tipos de roles que desempeñan determinados papeles y que tienen unos permisos específicos para realizar tareas:

- Propietario: un propietario tiene control total. Puede agregar y eliminar a otros usuarios, cambiar la configuración, ver todos los datos y acceder a todas las herramientas. Un propietario verificado ha completado el proceso de verificación de la propiedad, mientras que uno no verificado ha sido agregado como un propietario delegado. (Los propietarios delegados pueden agregar otros propietarios delegados).

- Usuario: puede ver todos los datos y realizar algunas acciones, pero no puede agregar nuevos usuarios. Los usuarios completos pueden ver la mayoría de los datos y realizar algunas acciones, mientras que los restringidos solo pueden ver algunos datos. Piensa detenidamente quién debería tener estos permisos. Darle la propiedad total a todo el mundo en una empresa podría ser desastroso. Puede haber cambios de configuración que se produzcan de manera accidental o problemas de este tipo. Por eso, dale a los miembros de tu equipo solo autoridad que necesiten.

- Asociado: puede asociar una propiedad de Google Analytics con una cuenta de Search Console, lo que le permitirá ver los datos de GSC en los informes de GA. También puede acceder a los informes de GA en dos secciones de Search Console: enlaces a su sitio y enlaces de sitio. Una propiedad de GA solo se puede asociar con un sitio de GSC y viceversa.

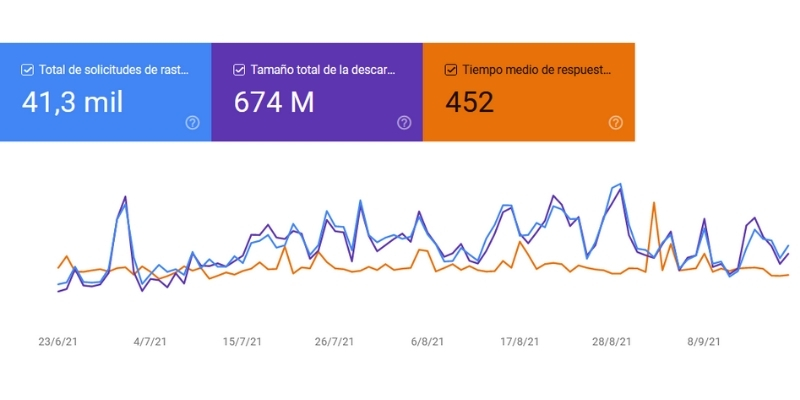

Rastreo

Esta sección proporciona los informes de rastreo de Google Search Console. Trata sobre cómo los robots de Google rastrean Internet y descubren las páginas en tu sitio. Gracias a la información que te proporcionan, podrás eliminar errores de rastreo con Google Search Console.

Los robots de Google utilizan un proceso algorítmico para rastrear, indexar y clasificar sistemáticamente el contenido. Visitan cada sitio web, detectan enlaces en la página y los utilizan como navegación para descubrir todas las páginas de cada sitio.

La sección de errores de rastreo también está siendo reemplazada por el informe «Cobertura del índice». Se utiliza para encontrar errores 404 que luego debes redireccionar a páginas operativas para mejorar la experiencia del usuario. Los errores 404 no cuentan directamente en tu contra en los algoritmos de Google, pero pueden ser perjudiciales porque quien estaba tratando de acceder a ese enlace no puede hacerlo. Redirigir estas páginas a las adecuadas puede mejorar la experiencia del usuario y, para los enlaces externos, recuperaría esas páginas para contar en el algoritmo.

Por otro lado, dispones de un apartado de «estadísticas de rastreo». A primera vista, esta página no es tan útil, pero ofrece una gran cantidad de información adicional sobre cómo visita Google tu sitio. Lo ideal es que los gráficos muestren una línea lo más horizontal posible, sin picos o caídas intensas. Generalmente, los tres gráficos también deberían verse bastante similares. Si ves picos anormales o períodos de inactividad, podría ser un indicador de problemas.

Las caídas repentinas tienden a deberse a un código roto, problemas de bloqueo de robots.txt o que no estás actualizando tu contenido con la suficiente regularidad. Los picos repentinos generalmente son causados por subir una gran cantidad de contenido a tu sitio o el archivo robots.txt podría estar permitiendo que los robots rastreen demasiados rincones del sitio.

Esto puede volverse un aspecto decisivo si tienes un sitio de comercio electrónico. Estos tienden a presentar mucha variación en cada producto, la mayoría tiene una URL única. Si gastas todo tu presupuesto de rastreo en variables sin importancia para un producto en lugar de las páginas principales de tu sitio, es posible que se actualice en el índice de Google con menos frecuencia y, por lo tanto, perjudique el sitio web en general.

Herramientas e informes antiguos

Con la nueva versión, algunos restos de la antigua han ido desapareciendo. Fue en 2019, el 9 de septiembre, cuando se eliminó la sección «Ir a la versión anterior». Fue sustituida por enlaces directos en una sección creada denominada «Herramientas e informes antiguos«.

Desde entonces ya no se puede acceder al dashboard de la versión anterior. Lo mismo ocurre con la antigua página de inicio y con algunas funcionalidades que no están ya operativas. Hay una serie de redirecciones, con informes, por ejemplo, que llevan a la nueva interfaz.

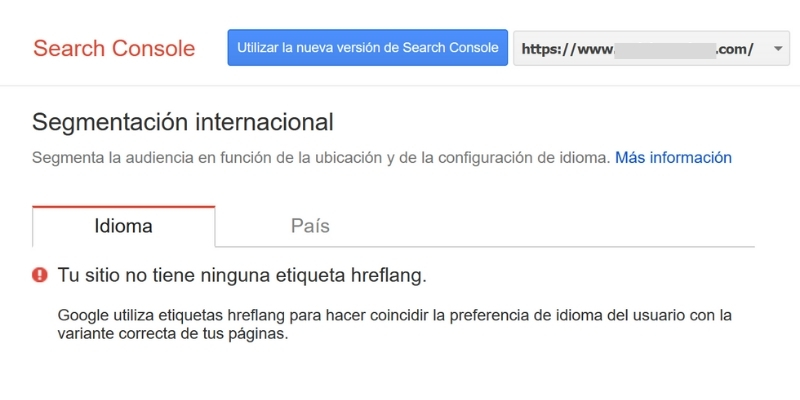

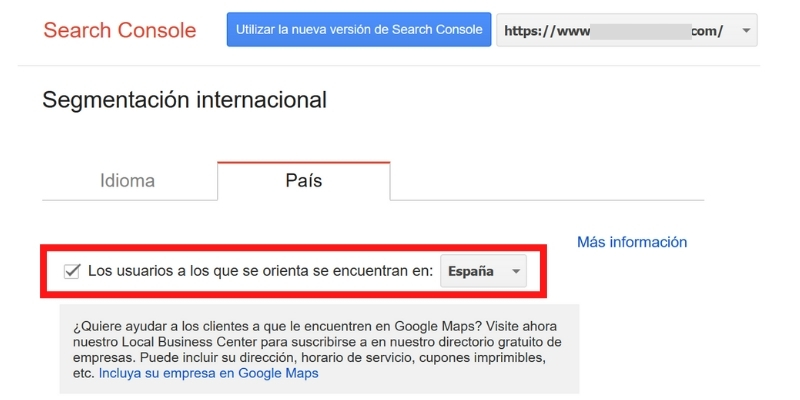

Segmentación internacional

Google es un buscador web a nivel mundial, por lo que es importante informarle de qué país pretendes que vengan la mayoría de los visitantes de tu sitio web. Si prestas servicios en varios países o en más de un idioma, también deberías incluir esa información en esta herramienta.

Si su sitio ofrece varios idiomas, debes utilizar etiquetas hreflang para asegurarte de que Google esté ofreciendo la versión correcta de tus páginas según la configuración del navegador del usuario.

Aquí también puedes establecer tu país de destino. Lo más recomendable es establecerlo para el lugar donde reside tu principal base de clientes. Esto no excluye necesariamente a los buscadores de otros países de encontrar tu sitio web, pero lo más probable es que las búsquedas lo destaquen solo en ese país concreto.

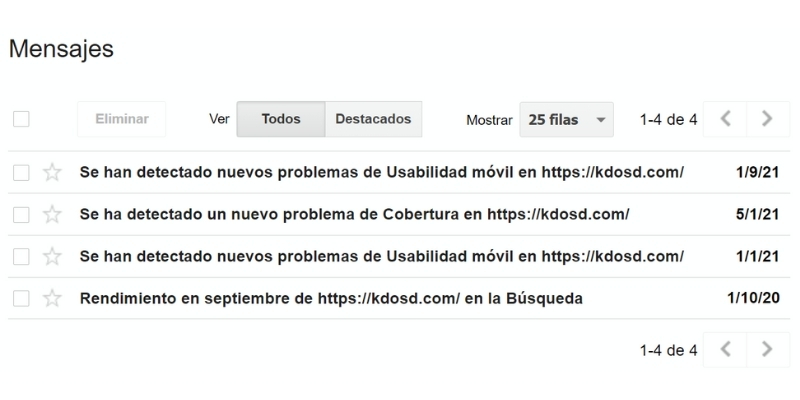

Mensajes

Este panel es útil en el sentido de que te permite echar un vistazo a todos los mensajes que te manda esta herramienta al correo electrónico. Es una especie de buzón donde encontrarás todas las alertas sobre la usabilidad, la cobertura o cualquier otra información que te haya llegado por ese inbox. Como decimos, tu correo de Gmail recibirá también todos esos mismos mensajes, así que los tendrás por duplicado.

No obstante, también puedes cambiar la configuración para que solo te lleguen al panel de la interfaz y dejen de llegar a tu correo electrónico. También hay mensajes que llegan exclusivamente a los propietarios o los usuarios, siempre que haya habido una configuración adecuada.

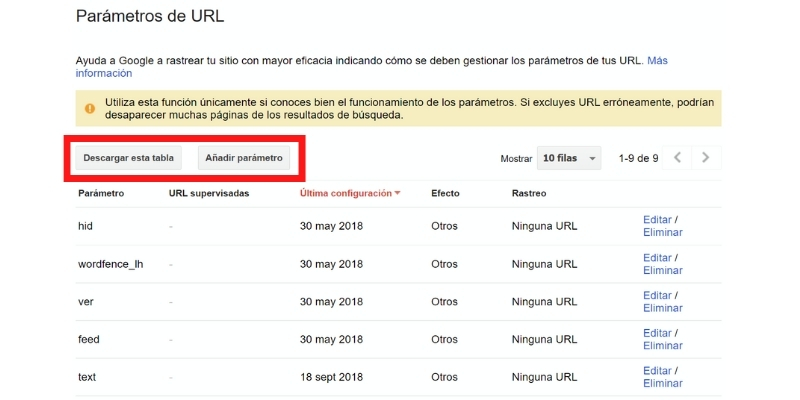

Parámetros URLs

La mayoría de los sitios nunca tendrán que lidiar con parámetros de URL, porque no tienen suficientes enlaces que puedan ser identificadas como contenido duplicado. Esto es, una vez más, un problema que se presenta, principalmente, en los sitios de comercio electrónico. Básicamente, se deben configurar parámetros para indicarle a Google qué URL no necesita seguir para maximizar el presupuesto de rastreo.

Web tools

En este panel encontrarás algunas herramientas web para realizar diferentes acciones. Entre ellas estará el Informe de experiencia de usuario para ordenadores y móviles, un apartado de experiencias engañosas, herramientas de pruebas y los siguientes recursos de Google:

- Google My Business.

- Google Merchant Center.

- PageSpeed Insights.

- Motores de búsqueda personalizados.

- Dominios de Google.

- Academia para webmasters.

- Google Ads.

- Google Analytics.

También encontrarás en el menú un enlace de vuelta que te llevará de nuevo al panel principal de Google Search Console. Si tienes dudas, el centro de ayuda te facilitará lo que necesites.

Asociar Google Search Console con Analytics

Vincular Google Analytics y Search Console es una acción que te permitirá obtener mejores resultados en los análisis de datos. Conseguirás una visión más completa, desde la perspectiva del usuario y desde la de los motores de búsqueda.

De hecho, esa es la diferencia entre Google Analytics y Google Search Console, su diferente enfoque a la hora de llevar a cabo la recopilación de datos y la elaboración de informes.

Así, una vez que hayas verificado la propiedad de tu sitio en Search Console podrás vincularlo con Analytics. Es una forma maximizar el uso de los datos, con la mirada puesta en la toma de decisiones de marketing.

En la pugna Google Search Console vs Google Analytics no hay un claro ganador. La diferencia es que uno te habla sobre las búsquedas y el otro sobre el comportamiento y el perfil de los visitantes. Te proporcionan datos demográficos de la audiencia, ubicación geográfica, fuente de tráfico (social, orgánico, pagado, etc.), conversiones y otra gran cantidad de información útil.

Google Search Console te ofrece más una descripción técnica de cómo se está comportando tu sitio. Te indica qué resultados obtiene en los buscadores de Internet y si hay algún problema que Google ha detectado. También te dice qué palabras clave te posicionan mejor de manera orgánica.

Para asociar las dos propiedades, debes hacer clic en el ícono de ajustes en la esquina superior derecha y seleccionar Propiedad de Google Analytics. Selecciona la opción de vincular o sincronizar ambas cuentas y solo tendrás que hacer clic para finalizar la acción. Con eso disfrutarás de informes de Search Console vinculados con los de Analytics. Estarás apoyado por el centro de asistencia comunidad search console.

Como ves, el nuevo Google Search Console puede hacerte subir a un nivel mucho más alto en lo que respecta al posicionamiento SEO de tu sitio web por ejemplo. Descubre que consultas llevan usuarios a tu web. Ya puedes empezar a poner en práctica ya todos estos pequeños aprendizajes y pronto estarás familiarizado con su interfaz. Así obtendrás una visión mucho más acertada del desempeño de tu website. No obstante, si quieres optimizar su uso, recurre a una agencia experta en la materia. Ahorrarás tiempo y rentabilizarás la inversión con creces.